Changelog

Wir arbeiten ständig an neuen Funktionen und Verbesserungen. Entdecke hier, was es Neues gibt:

Assistenten Templates

Unsere Assistenten Templates sind live! 🎉

Eines der am häufigsten gewünschten Features ist da: Die Assistenten Templates bieten dir 24 verschiedene Templates, die wir auf Basis beliebter Anwendungsfälle unserer Kunden sowie der Erfahrungen aus unserem eigenen Team entwickelt haben. Jetzt kannst du passende Assistenten Templates auswählen, direkt nutzen oder individuell anpassen.

Abteilungsspezifische & allgemeine Templates: Finde Assistenten, die speziell für bestimmte Abteilungen (bspw. Finance, Marketing oder Sales) zugeschnitten sind, oder wähle aus universellen Helfern für allgemeine Anwendungsfälle.

Flexible Nutzung: Verwende die Assistenten direkt oder passe die Vorlagen an, indem du Anweisungen änderst, Wissensordner hinzufügst oder eigene Integrationen verbindest.

Eingebaute Best Practices: Jedes Template enthält erprobte Best-Practices, die Produktivität und Effizienz steigern.

Integrationen prüfen: Einige Assistenten nutzen Integrationen, die in deinem Workspace eventuell nicht aktiviert sind. Stelle sicher, dass die benötigten Integrationen verfügbar und für deinen Anwendungsfall relevant sind.

Template Beispiele:

- Google Meeting Planer

- Firmendokumentation Q&A

- Nutzerfeedback Analyst

- Marketing Texter

- Langdock Integrationen bauen

- Assistenten Ersteller

Wir freuen uns auf dein Feedback und deine Ideen für neue Assistenten Templates! Wir werden auch in Zukunft weitere nützliche Templates hinzufügen.

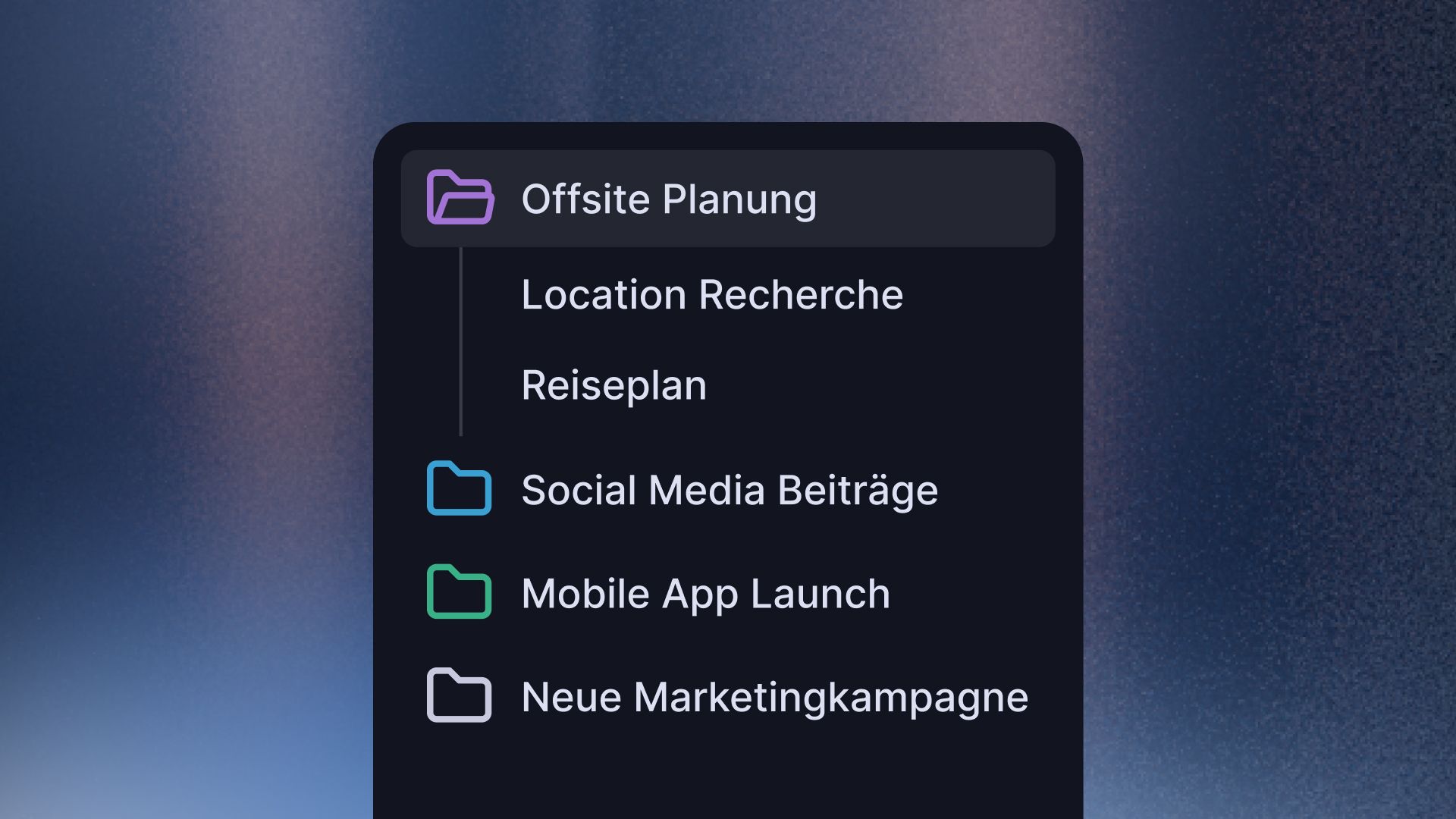

Ordner aus Integrationen synchronisieren

Du kannst jetzt Ordner aus deinen Integrationen innerhalb von Langdock Assistenten synchronisieren.

Unterstützte Integrationen: Du kannst ab sofort Dateien aus Ordnern in SharePoint oder Google Drive direkt in Langdock nutzen und so nahtlos mit deiner Wissensbasis arbeiten. Hinweis: Die Integrationen müssen im Workspace aktiviert sein.

Ordner an Assistenten anhängen: Neben einzelnen Dateien kannst du nun auch komplette Ordner direkt an deine Assistenten anhängen. So kannst du zum Beispiel einen Ordner deiner Abteilung, eines Kunden oder eines aktuellen Projekts direkt mit deinem Assistenten teilen. Klicke dazu einfach im Wissensbereich auf „Anhängen“ und suche nach dem gewünschten Ordner.

Immer aktuell: Alle angehängten Ordner werden täglich synchronisiert, damit du stets auf dem neuesten Stand bist.

Datei- und Formatbeschränkungen: Aktuell werden pro Ordner bis zu 200 Dateien unterstützt. Tabellen und Bilder sind derzeit noch nicht verfügbar.

Zugriffskontrolle: Admins können in den Workspace-Einstellungen unter Rollen festlegen, wer die Ordnersynchronisation nutzen darf.

Wir freuen uns auf dein Feedback, um unsere Integrationen stetig zu verbessern und zu erweitern!

Actions in Chat

Wir freuen uns, dir einen großen Produktivitäts-Boost in Langdock anzukündigen: Actions in Chat! 🚀

Ab sofort kannst du leistungsstarke Funktionen direkt aus dem Chat heraus nutzen, indem du einfach @ eingibst. Dieser neue Shortcut ermöglicht es dir, schnell vier verschiedene Actions direkt im Chat auszuwählen. Damit kannst du schneller und nahtloserer mit Assistenten, Integrationen und Wissensordnern arbeiten.

Übersicht der verschiedenen Action-Typen in Chat:

- Assistenten: Rufe sofort deine individuellen Assistenten auf, um Aufgabe direkt aus dem Chat heraus zu erledigen. So kannst du mehrere Assistenten in denselben Chat einbinden. Ein Beispiel: Ein Changelog-Assistent erstellt Beiträge zu Feature Updates, ein anderer übersetzt diese anschließend in eine zweite Sprache.

- Integrationen: Nutze verschiedene Integrationen direkt im Chat, ohne dafür einen Assistenten erstellen zu müssen. Du kannst aus 35 vorgefertigten Integrationen mit über 300 Actions wählen. Welche Integrationen du genau nutzen kannst, hängt von den Einstellungen deines Workspaces ab.

- Prompt-Bibliothek: Selbstverständlich kannst du weiterhin Prompt-Vorlagen aus deiner Bibliothek verwenden. Diese Funktion ist vom "/" zu "@" gewechselt, um mit den anderen Actions konsistent zu sein.

- Wissensordner: Füge relevante Wissensordner zu deinem Chat hinzu, um fundiertere Antworten zu erhalten.

Actions in Chat sind besonders hilfreich, um Assistenten und Integrationen spontan in einem Chat zu kombinieren. Gib einfach @ ein und erhalte, was du brauchst genau dort, wo du gerade arbeitest. Für spezifische Anwendungsfälle, die sich teamweit skalieren lassen und regelmäßig genutzt werden sollen, lohnt es sich weiterhin, einen Assistenten mit klaren Anweisungen zu erstellen.

Dieses Update hilft dir, noch schneller und effizienter in Langdock zu arbeiten. Wie immer freuen wir uns auf dein Feedback und sind gespannt, wie du Actions in Chat nutzen wirst!

- Verbesserte Plattformleistung & Geschwindigkeit: In den letzten Tagen haben wir zahlreiche Verbesserungen umgesetzt, die Langdock schneller und zuverlässiger machen. Langdock hat jetzt kürzere Ladezeiten und höhere Stabilität.

- Optimierte Outlook-Kalenderintegration: Du kannst wiederkehrende Termine einrichten, Online-Meetings veranstalten und Meeting-Anbieter problemlos auswählen. Die Terminplanung ist dank Massenlöschung von Terminen, besseren Filtern und intelligenterer Zeitvorschläge einfacher geworden.

- Integration von Microsoft Planner: Organisiere deine Pläne, Aufgaben und Buckets ganz einfach und übersichtlich. Sieh dir Kommentare an und automatisiere Workflows, wenn Aufgaben erstellt oder abgeschlossen werden.

- Integration von AWS Kendra: Durchsuche AWS Kendra mit natürlichen Sprachabfragen, erweiterten Filtern und personalisierten Ergebnissen, um schneller die richtigen Informationen zu finden.

GPT-5

Wir freuen uns, heute GPT-5 in Langdock ankündigen zu können!

OpenAI hat gerade ihre GPT-5 Serie veröffentlicht, deren bisher fortschrittlichsten Sprachmodelle. Wir haben gerade GPT-5, GPT-5 mini und GPT-5 nano in Langdock hinzugefügt. Die Modelle sind besser als die vorherige GPT-4.1 Generation – GPT-5 mini ist bereits besser als GPT-4.1 und in einigen Bereichen sogar als o3.

Mit einem viel größeren Kontextfenster und schnelleren Antwortzeiten ermöglicht GPT-5 nahtlosere und produktivere Arbeitsabläufe – egal ob ihr komplexe Recherchen durchführt, lange Inhalte generiert oder fortschrittliche Assistenten entwickelt.

Die wichtigsten Highlights sind:

- Verbesserte Argumentation & Programmierung: Erreicht bessere Ergebnisse bei technischen, analytischen und programmierenden Aufgaben.

- Längerer Kontext: Arbeitet mit erweiterten Dokumenten und Gesprächen, ohne den Kontext zu verlieren.

- Schnellere Antworten: Genießt eine spürbar schnellere und interaktivere Antwortzeit.

Wir haben die Modelle gerade zu Langdock hinzugefügt, sodass ihr es jetzt in euren Chats und Assistenten auswählen könnt.

Projekte

Wir freuen uns, Projekte vorzustellen, eine neue Organisationsfunktion, die dir mehr Flexibilität bei der Organisation deiner Chats bietet und dir hilft, an größeren Projekten zu arbeiten.

Was sind Projekte?

Mit Projekten kannst du Chats in einem bestimmten Kontext gruppieren. Egal, ob du an der nächsten Marketingkampagne oder einem anderen Projekt arbeitest, alle deine Chats bleiben zusammen. Um deinen Workflow noch weiter zu verbessern, kannst du jedem Projekt benutzerdefinierte Anweisungen und Dateien hinzufügen.

Jedes Projekt enthält:

- Angehängte Dateien, auf die in allen Projekt-Chats zugegriffen werden kann, ohne sie erneut hochladen zu müssen

- Projektspezifische Anweisungen, die das KI-Verhalten für diese Chats anpassen

So funktionieren Projekte:

- Erstelle ein Projekt für deinen spezifischen Zweck.

- Lade relevante Dokumente hoch.

- Lege individuelle Anweisungen fest, um das KI-Verhalten für dieses Projekt zu steuern.

- Beginne mit dem Chatten und erhalte vollen Zugriff auf den Projektkontext und die Dateien.

Du kannst dein erstes Projekt über die Sidebar erstellen. Wir freuen uns auf dein Feedback dazu, ob das in deinen Workflow passt!

MCP Unterstützung

Wir freuen uns, bekannt zu geben, dass Langdock jetzt das Model Context Protocol (MCP) unterstützt! 🚀

Was ist MCP?

MCP ist ein offenes Protokoll, das vereinheitlicht, wie KI-Anwendungen mit Datenquellen und Tools verbunden werden. Man kann sich MCP wie einen USB-C-Anschluss für KI-Anwendungen vorstellen: Genauso wie USB-C eine einheitliche Verbindung für verschiedene Geräte bietet, ermöglicht MCP eine einheitliche Anbindung von KI-Modellen an unterschiedliche Datenquellen und Tools.

Konkret kannst du deine Assistenten jetzt mit remote MCP-Servern über das Internet verbinden. Dadurch ergeben sich noch mehr Integrationsmöglichkeiten mit verschiedenen Datenquellen – zusätzlich zu den bestehenden Integrationen.

Die wichtigsten Funktionen

- Flexible Authentifizierung: Funktioniert sowohl mit einfachen API-Keys als auch mit sicheren OAuth-Verbindungen für Dienste, die dies erfordern.

- Automatische Tool-Erkennung: MCP-Verbindungen erkennen automatisch, welche Tools auf jedem Server verfügbar sind.

- Nahtlose Integration: MCP-Tools funktionieren direkt in deinen Assistenten-Konversationen (können Bestätigungen erfordern und Eingaben/Ausgaben anzeigen).

- Kontinuierliches Berechtigungsmanagement: MCP-Integrationen sind vollständig in unser bestehendes Integrations-Framework eingebettet – du kannst Berechtigungen, Freigaben und Nutzung wie bei allen anderen Langdock-Integrationen steuern.

- Geprüfte Kompatibilität: Wir haben die Kompatibilität mit bekannten MCP-Servern wie Microsoft Docs, Cloudflare Docs und GitHub verifiziert. Generell unterstützen wir alle offenen MCP-Server (ohne Authentifizierung) und MCP-Server mit API-Authentifizierung.

So startest du mit MCP

Du kannst MCP-Integrationen über den "Integrationen hinzufügen"-Button im Integrationsmenü einrichten. Dort kannst du auswählen, ob du wie bisher eine Integration mit JavaScript bauen oder einen MCP-Server anbinden möchtest. Für das Einrichten von MCP-Integrationen benötigen Nutzer die Berechtigung, eigene Integrationen zu erstellen.

Detaillierte Anleitungen findest du in unserer Dokumentation:

https://docs.langdock.com/resources/integrations/mcp

Hinweis: MCP befindet sich noch in einem sehr frühen Entwicklungsstadium. Wir empfehlen, alle Integrationen, die ihr mit MCP erstellt, vor dem produktiven Einsatz gründlich zu testen.

- Antwortgenerierung läuft im Hintergrund weiter: Die Antwortgenerierung läuft weiter, auch wenn du den Chat verlässt.

- Assistenten-Anweisungen mit KI optimieren: Du kannst jetzt die Anweisung deines Assistenten per KI optimieren oder deinen Prompt diktieren – einfach auf die Buttons im Anweisungsfeld klicken.

- Optimierte Assistenten-Konfiguration: Wir haben die Felder für Eingabetyp und Anweisung im Assistenten-Builder vertauscht, um die Nutzererfahrung zu verbessern.

- Schließbare Benachrichtigungen oben rechts: Du kannst Benachrichtigungen jetzt oben rechts einfach wegklicken.

- Verbesserte CSV- und Excel-Vorschau: Die Vorschau und Verarbeitung von Tabellen-Dateien beim Hochladen in Assistenten und Chats wurde verbessert.

- Erweiterte Modellbeschreibungskarten: Der Modellselektor zeigt jetzt präzise Fähigkeiten und kurze Beschreibungen, sodass du Modelle mit Reasoning, Websuche und Datenanalyse leichter auswählen kannst.

- Verbesserter Formular-Builder für Assistenten: Assistenten-Formulare unterstützen jetzt bis zu 15 Felder.

- Test-Button für eigene Modelle: Eigene Modelle können jetzt direkt in den Workspace-Einstellungen per Test-Button ausprobiert werden.

- Anhänge ohne Texteingabe: Du kannst jetzt Dateien direkt ohne Prompt hochladen.

- Kontext-Aktionen: Früher musstest du abhängige Aktionen wie das Abrufen einer Channel-ID manuell vor dem Senden einer Slack-Nachricht an einen Gruppenchat hinzufügen, damit der Assistent die Aufgabe korrekt ausführt. Das war bisher umständlich, um herauszufinden, warum der Assistent nicht funktionierte. Jetzt sind bei Aktionen, die zusätzliche Infos wie IDs benötigen, die notwendigen abhängigen Aktionen standardmäßig enthalten. Das erkennst du am kleinen Link-Icon auf der Aktionskachel und beim Öffnen der Aktion per Toggle.

Neu in Langdock

Deep Research

Wir freuen uns, Deep Research vorzustellen! Deep Research ist ein neues Chat-Feature, das für umfassende, lange Forschungsberichte entwickelt wurde, für die eine tiefgreifende Analyse aus mehreren Quellen erforderlich ist.

Was ist Deep Research?

Deep Research wurde für komplexe Recherchen entwickelt. Es führt mehrere strategische Webrecherchen durch, prüft Ergebnisse aus verschiedenen Quellen und fasst alles in einem strukturierten Bericht zusammen.

Wann ist es sinnvoll, Deep Research zu verwenden?

Deep Research eignet sich besonders gut für Hintergrundrecherchen, die Erforschung von Branchentrends, Markt- und Wettbewerbsanalysen, akademische Forschung, strategische Planung und alle Aufgaben, die eine umfassende Informationsbeschaffung aus mehreren Online-Quellen erfordern. Der daraus resultierende Bericht mit Zitaten kann als PDF heruntergeladen werden, was stundenlange manuelle Recherchen und Zusammenstellungen erspart.

Wie funktioniert das Feature?

Deep Research plant seine Suchstrategie auf intelligente Weise, um Erkenntnisse aus verschiedenen Perpektiven zu gewinnen. Die Suchaktivität mit Quellen kann in Echtzeit verfolgt werden. Unabhängig davon, welches Modell im Chat ausgewählt wird, verwendet Deep Research immer vorkonfigurierte Modelle, um die bestmögliche Qualität zu gewährleisten. Derzeit gibt es eine Nutzungsbeschränkung von 15 Suchen pro Nutzer und Monat.

Deep Research ist jetzt in allen Workspaces verfügbar! 🚀

Ein weiterer Hinweis: Microsoft Azure hat derzeit einige Geschwindigkeitsprobleme mit GPT-4.1. Obwohl wir es immer noch als Standardmodell empfehlen, könnt ihr auch GPT-4.1 mini als schnellere Alternative ausprobieren.

Neue Modelle verfügbar!

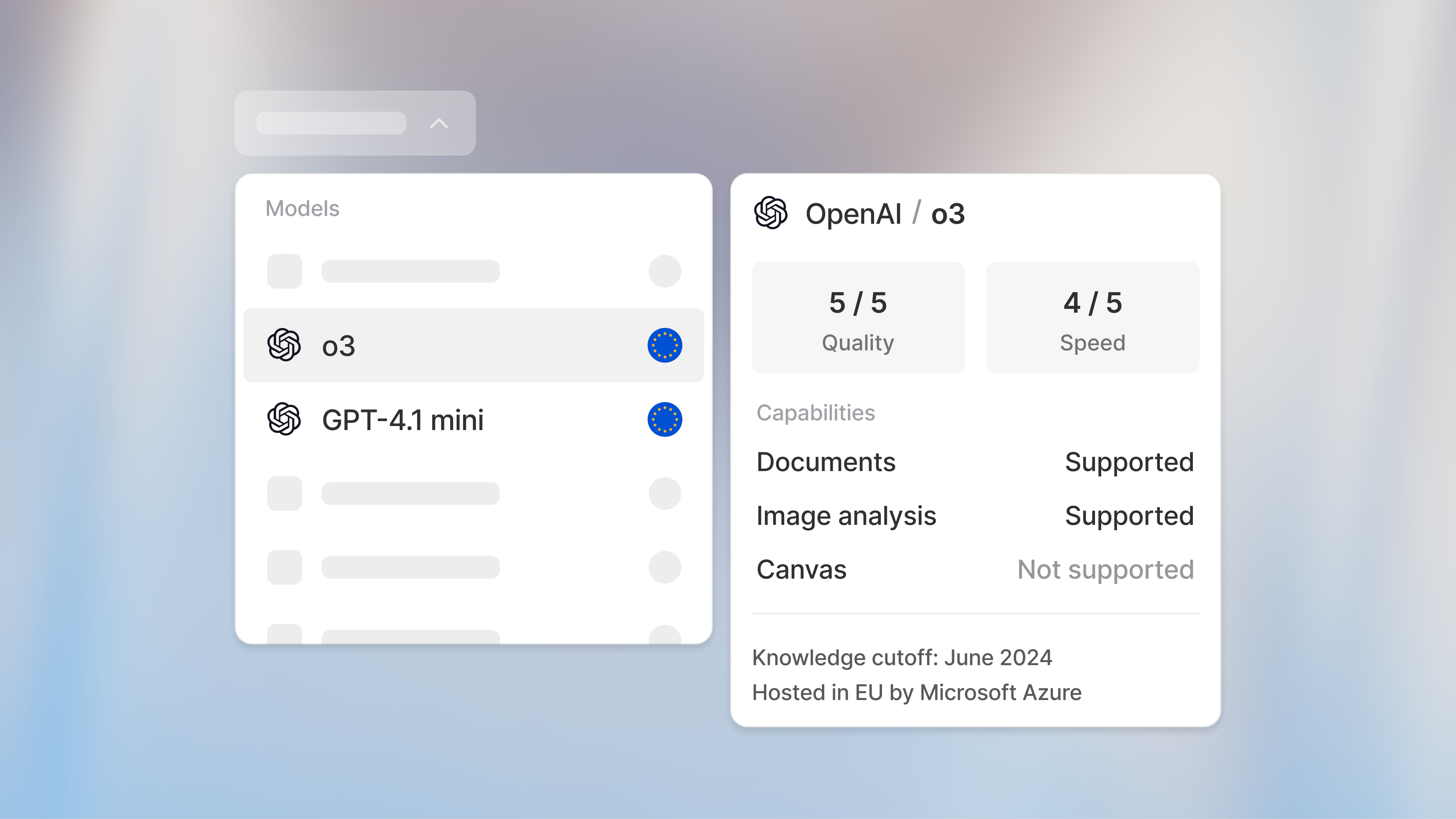

o3 und GPT-4.1 mini

Wir freuen uns, bekannt zu geben, dass o3 und GPT-4.1 mini jetzt in Langdock verfügbar sind! 🚀

o3 ist OpenAIs leistungsstärkstes Reasoning-Modell, das neue Standards bei Programmierung, Mathematik, Wissenschaft und visueller Problemlösung setzt. Es zeichnet sich bei technischem Schreiben, der Befolgung von Anweisungen und der Bewältigung komplexer mehrstufiger Probleme aus. o3 ist perfekt für Strategie-, Forschungs- und Programmieraufgaben geeignet, die anspruchsvolle Problemlösungsfähigkeiten erfordern.

GPT-4.1 mini ist die kleinere, schnellere Version von GPT-4.1, entwickelt für alltägliche Aufgaben mit deutlich schnelleren Antworten. Dieses effiziente Modell liefert eine Leistung, die mit GPT-4o konkurrenzfähig ist, während es die Latenz um fast die Hälfte reduziert. GPT-4.1 mini eignet sich hervorragend für große Aufgaben, Echtzeitanwendungen und schnelle Inhaltserstellung. Das Sprachmodell war zuvor als globale Bereitstellung verfügbar und ist nun in der EU verfügbar.

Beide Modelle sind jetzt live. Wähle o3 für fortgeschrittenes Reasoning und Intelligenz oder GPT-4.1 mini für Geschwindigkeit und Effizienz!

Wichtiger Hinweis: Wir werden GPT-4.5, o1 (Preview), o1 mini und Gemini 1.5 Pro am 11. Juli außer Betrieb nehmen. Diese Modelle werden ab diesem Datum nicht mehr auf Langdock verfügbar sein. Wir empfehlen, auf die neueren Versionen dieser Modelle umzusteigen.

Neu in Langdock

Verbessertes Canvas

Wir freuen uns, dass Canvas nun aus der Beta-Phase ist und allen Langdock-Nutzern zur Verfügung steht! 🎉

Canvas ist unsere interaktive Bearbeitungsoberfläche um eure Schreib- und Programmieraufgaben zu vereinfachen. Mit Canvas könnt ihr Texte und Code direkt bearbeiten und dabei Vorschläge von der KI erhalten.

Diese Version enthält einige wichtige Updates, die auf eurem Feedback seit dem Start der Beta-Phase basieren. Vielen Dank an alle, die mit ihren Ideen und Vorschlägen zur Entwicklung der Canvas-Funktion beigetragen haben.

Highlights dieser Version:

- Optimierte Benutzeroberfläche: Wir haben die Nutzeroberfläche übersichtlicher gestaltet, um eure Arbeitsabläufe reibungsloser und intuitiver zu gestalten.

- Integrierte Codierungswerkzeuge: Ihr könnt nun Code direkt über das integrierte Terminal in Canvas generieren und ausführen.

- Als Datei herunterladen: Du kannst dein Canvas jetzt als PDF-, Word- und Markdown-Dokument herunterladen.

- Vereinfachte Modellauswahl: Es ist nicht mehr erforderlich, ein separates Canvas-Modell auszuwählen; alles funktioniert nahtlos mit den Hauptmodellen, die ihr bereits täglich verwendet.

Ihr könnt das Modell auffordern, Canvas zu verwenden, oder alternativ den Canvas-Modus durch Klicken auf die Schaltfläche im Chatfeld aktivieren.

Wir sindständig bemüht, Canvas zu verbessern, und freuen uns auf euer Feedback.

- Verbesserte „Neuer Chat“ und „Suche“ Buttons: Wir haben das Design der Buttons in der Navigationsleiste verbessert, um einen neuen Chat zu öffnen und die Befehlsleiste zu öffnen.

- Aktionsberechtigungen: Adminis können jetzt Zugriffsberechtigungen für einzelne Aktionen definieren, indem sie einzelnen Benutzern und/oder Gruppen Zugriff gewähren. Sie können zur Integration gehen, die verwaltet werden soll, und dort die Berechtigungen für einzelne Aktionen einstellen.

- Neue Integrationen: Wir haben Integrationen zu Monday und Google Meet (zum Abrufen von Transkripten) hinzugefügt

- Neue Dateiformate: Die Dateiformate .dotx, .rtf, .kml, .gml, .dxf, .gpx, .shp, .shx, .dbf und .prj werden jetzt unterstützt.

- Verbesserter Upload von Dokumenten: Wir haben das Upload-Verhalten von Dateien verbessert, insbesondere für größere Mengen an Dateien.

- Mermaid-Diagramme: Mermaid-Flussdiagramme können jetzt auch als Bilder heruntergeladen werden.

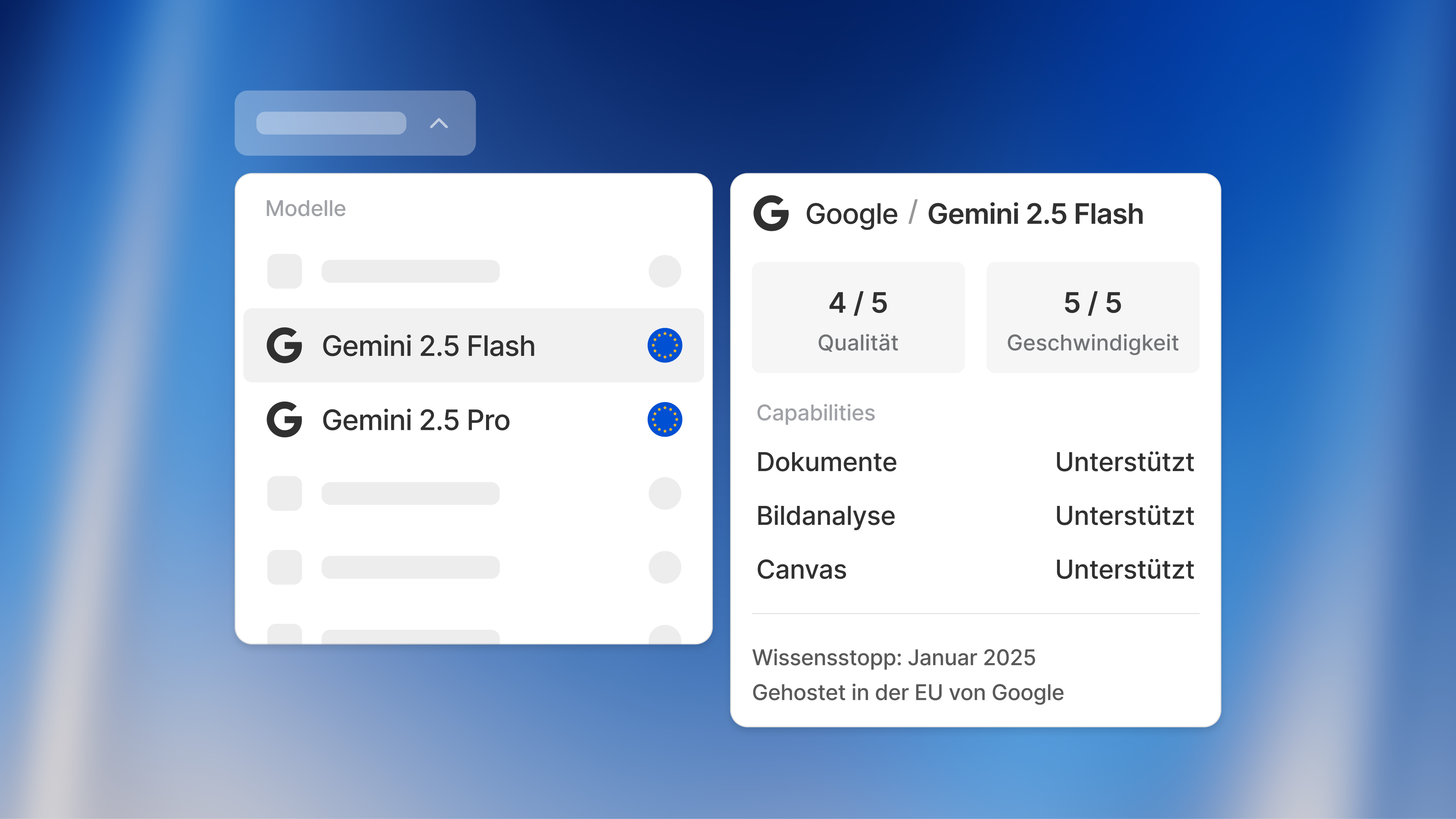

Neues Modell verfügbar!

Gemini 2.5 Flash and Gemini 2.5 Pro

Wir freuen uns, euch mitteilen zu können, dass Gemini 2.5 Flash und Gemini 2.5 Pro jetzt bei Langdock erhältlich sind! 🚀

Gemini 2.5 Flash ist das schnellere und effizientere Modell der Version 2.5, das für Echtzeit-Aufgaben mit hohem Datenvolumen entwickelt wurde. Es liefert schnelle Antworten, unterstützt bis zu 1 Million Kontext-Token und eignet sich ideal für sofortiges Schreiben, Zusammenfassen und Fragen und Antworten.

Perfekt für Assistenten und Chats, bei denen Geschwindigkeit und Effizienz am wichtigsten sind.

Gemini 2.5 Pro ist das fortschrittlichste Modell von Google für komplexe Schlussfolgerungen, Codierung und multimodale Aufgaben. Vergleichbar mit den Modellen „Claude Sonnet“ und „o“ von OpenAI ist Gemini 2.5 Pro ideal für Strategie-, Recherche- und Programmieraufgaben, die fortgeschrittene Problemlösungsfähigkeiten erfordern.

Beide Modelle sind jetzt verfügbar – wählt Flash für Schnelligkeit und Effizienz oder Pro für Intelligence und Tiefe.

Workspace-Administratoren können diese Modelle in den Workspace-Einstellungen unter der Registerkarte „Modelle” aktivieren.

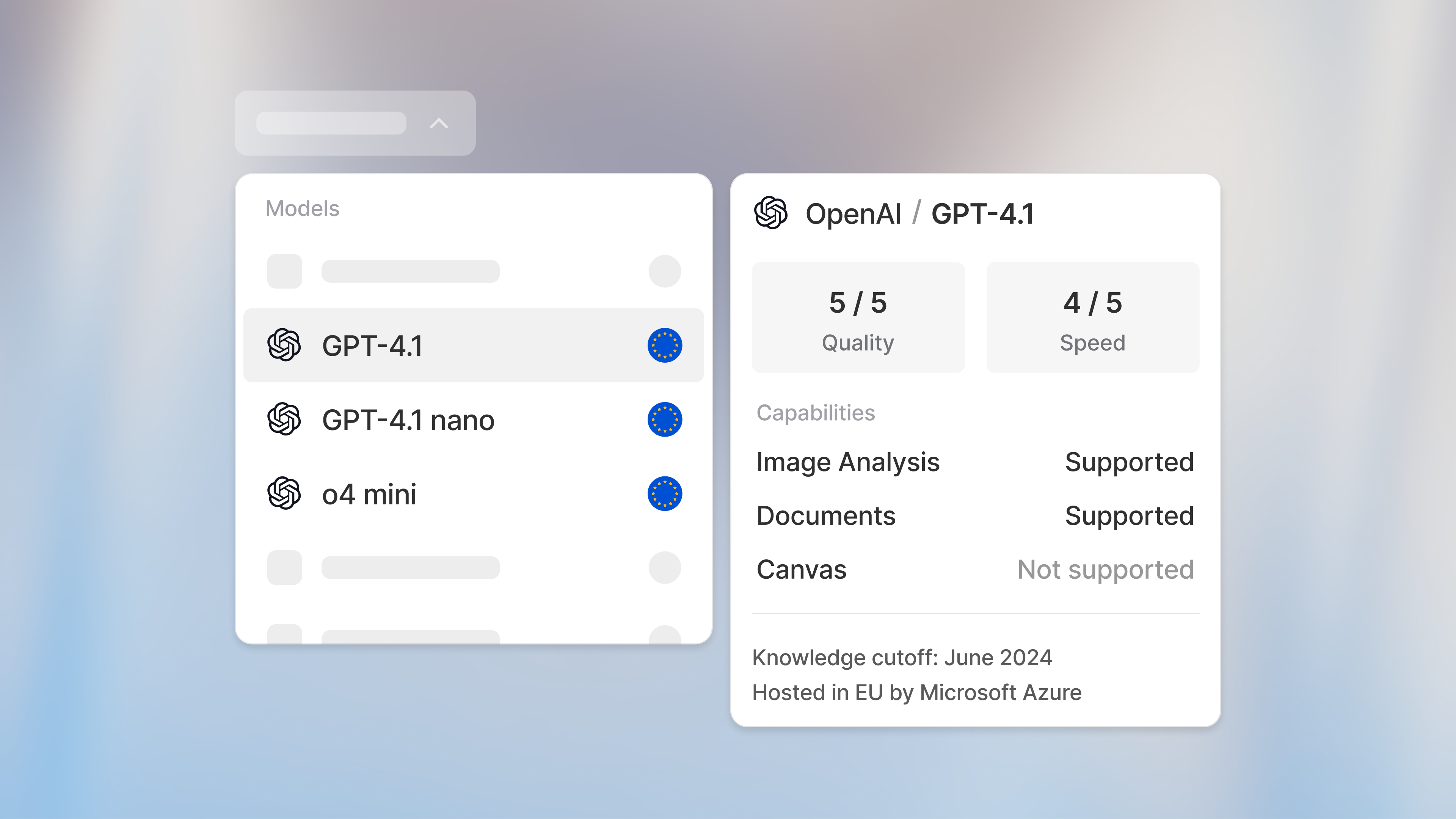

GPT-4.1 and o4 Mini

Wir freuen uns, bekannt zu geben, dass GPT-4.1 und o4 Mini jetzt in der EU gehostet und in Langdock verfügbar sind. 🙌

GPT-4.1 ist die neueste Version der GPT-4-Serie und bietet bessere Leistung in Geschwindigkeit und Qualität als die vorherige Version. Wir haben GPT-4.1 als Standardmodell für alle neuen Workspaces auf Langdock festgelegt. Zusätzlich wurden alle Workspaces, die zuvor auf GPT-4o, GPT-4o Mini oder GPT-4 eingestellt waren, auf GPT-4.1 als Standardmodell migriert.

Außerdem freuen wir uns, o4 Mini als neues Modell für Langdock vorzustellen. o4 Mini wurde für schnelles, effizientes Denken entwickelt und ist hervorragend geeignet, komplexe Anweisungen, Programmierung und strategische Aufgaben zu bewältigen. Ähnlich wie o3 Mini bietet es eine starke Balance zwischen Geschwindigkeit und Genauigkeit.

- Einstellung von GPT-4: Wie im letzten Changelog mitgeteilt, wird GPT-4 bis Ende dieser Woche auf Langdock vollständig eingestellt, nachdem Microsoft Azure die Unterstützung dafür eingestellt hat. Assistenten, die zuvor GPT-4 verwendet haben, verwenden nun automatisch das Standardmodell des Workspaces oder GPT-4.1.

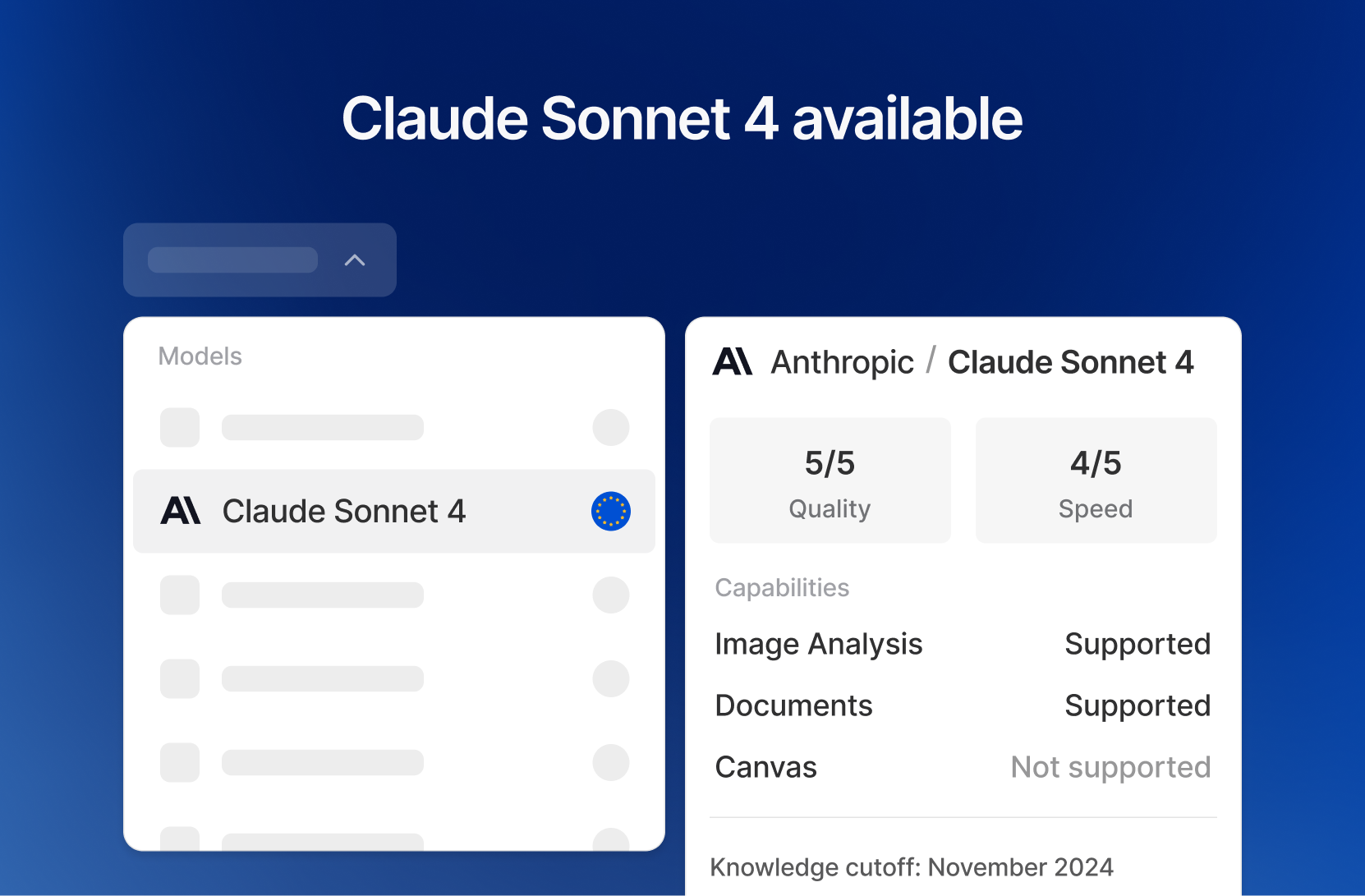

Claude Sonnet 4

Wir haben die neue Claude-Version in Langdock integriert! 🚀

Claude Sonnet 4 ist der Nachfolger von Sonnet 3.7, ein Modell, das von vielen unserer Nutzer für Texterstellung, Programmierung und Problemlösungsaufgaben bevorzugt wird.

Wie bei Sonnet 3.7 bietet auch Sonnet 4 die Möglichkeit, für komplexe Aufgaben Reasoning zu nutzen. Aus diesem Grund haben wir die Modi als zwei separate Modelle hinzugefügt: Claude Sonnet 4 (Preview) und Claude 4 (Reasoning Preview).

Die neuen Funktionen von Claude Sonnet 4 umfassen:

- Texterstellung: Wie frühere Sonnet-Versionen behält Claude Sonnet 4 seine Stärke bei der Erstellung natürlicher, menschenähnlicher Texte für Schreibaufgaben bei, darunter E-Mails, Übersetzungen und Content-Erstellung.

- Verbesserte Programmierleistung: Sonnet 4 überzeugt bei Programmieraufgaben, von der Generierung von Lösungen bis hin zur Navigation durch komplexe Codebasen mit nahezu null Fehlern.

- Verbesserte Steuerbarkeit: Das Modell bietet mehr Kontrolle über sein Verhalten und ermöglicht es Ihnen, seine Antworten an Ihre spezifischen Bedürfnisse anzupassen.

- Optimierte Effizienz: Sonnet 4 wurde entwickelt, um Leistungsfähigkeit und Praktikabilität in Balance zu halten und ist ideal für Assistenten, die sowohl Geschwindigkeit als auch Tiefe erfordern.

- Einstellung von GPT-4 Turbo: Am 8. Juni wird GPT-4 Turbo in Langdock eingestellt. Microsoft Azure beendet die Unterstützung für dieses Modell, und die neueren Modelle GPT-4o und GPT-4.1 bieten verbesserte Leistung und Geschwindigkeit. Assistenten, die GPT-4 Turbo verwenden, werden auf das Standard-Modell des Arbeitsbereichs umgestellt.

- Export von Assistenten-Feedback: Assistenten-Editoren können jetzt das Feedback aus den Nutzungseinblicken als CSV-Datei exportieren.

Mobile App

Die Langdock Mobile Apps sind jetzt live! Du kannst Langdock jetzt als Android- oder iOS-App herunterladen und KI direkt von deinem Handy aus nutzen.

Ab jetzt kannst du Langdock überall verwenden. Du kannst zwischen deinen Modellen wählen, den Chat nutzen und deine Assistenten verwenden.

Außerdem haben wir eine stark nachgefragt neue Funktion hinzugefügt: Du kannst jetzt deine Stimme als Eingabe verwenden, Langdock wird sie transkribieren und als Prompt abschicken. Achte auf das Mikrofon-Symbol im Eingabefeld!

Um die App herunterzuladen, gehe in den Apple App Store hier oder den Google Play Store hier.

- Spracheingabe im Browser: Neben der Spracheingabe in der mobilen App kannst du diese Funktion jetzt auch nutzen, wenn du Langdock im Browser verwendest.

- Assistenten Management: Admins haben jetzt mehr Möglichkeiten, Assistenten im Workspace zu verwalten. Admins können bestimmte Assistenten verifizieren, um sie in der Assistentenliste hervorzuheben, und können den Owner eines Assistenten neu zuzuweisen, falls der vorherige Owner das Unternehmen verlassen hat. Siehe Workspace-Einstellungen.

- Neue Integrationen: Wir haben neue Integrationen hinzugefügt, darunter Salesforce, GitHub, Slack, Airtable, Zendesk, Snowflake und DeepL.

- Erhöhtes Zeichenlimit für Textdateien: Wir haben das Limit für Textdateien von 2M auf 4M Zeichen erhöht.

- Admin Modus für Integrationen: Admins können jetzt alle Integrationen testen, bevor sie für den gesamten Workspace freigeschaltet werden. Der Zugriff auf Integrationen kann in den Workspace-Einstellungen verwaltet werden.

Neue GPT-4o Version

Die neueste Version von GPT-4o ist jetzt auf der Plattform verfügbar und bringt verbesserte Antwortqualität sowie schnellere Reaktionszeiten mit sich! 🚀

Zur Vereinfachung wurden die bisher getrennten Versionen "GPT-4o (latest)" und das reguläre "GPT-4o" zusammengeführt. Bei der Auswahl von "GPT-4o" wird nun automatisch die aktuellste Version bereitgestellt.

Die GPT-4o Bildgenerierungsfunktion, die vor einigen Tagen angekündigt wurde, ist aktuell noch nicht auf EU-Servern verfügbar. Wir werden diese Funktionalität hinzufügen, sobald dies der Fall ist.

Darüber hinaus wurden folgende oft gewünschte Verbesserungen vorgenommen:

- Formatierung beim Kopieren: Beim manuellen Kopieren von Textpassagen aus Chat-Antworten und Assistenten bleibt die Formatierung nun erhalten – genau wie beim Verwenden der Kopier-Funktion

- Native Mermaid-Diagrammunterstützung: Mermaid-Diagramme können nun direkt in unserem Chat erstellt werden. Dazu zählen Flussdiagramme, Sequenzdiagramme und viele mehr

- o3 mini via API: OpenAI's o3 Mini Reasoning-Modell ist jetzt über unsere API verfügbar

- Tabellenformatierung: Wir haben die Formatierung von Tabellen im Chat verbessert. Dies umfasst das Erscheinungsbild, das Kopierverhalten und die Möglichkeit, eine CSV der generierten Tabellen herunterzuladen

Neue Integrationen

Wir haben unsere neuen Integrationen gelauncht! Es ist jetzt viel einfacher, andere Software-Tools in Langdock zu integrieren, um Information abzurufen und Aktionen auszuführen. Das Update besteht aus drei Hauptteilen:

- 20+ native Integrationen sind ab sofort in Langdock verfügbar

- Integrationen für eure eigenen Tools können jetzt viel einfacher erstellt werden

- Verbesserungen bestehender Integrationen und Wissensordner

Neue Integrationen und Aktionen

Wir haben die Integration externer Tools in eure Assistenten erleichtert und viele neue Integrationen für die Tools gebaut, die unsere Kunden nutzen. Zum Beispiel könnt ihr jetztdie folgenden Integrationen nutzen: Jira, HubSpot, Google Sheets, Excel, Outlook, Google Kalender und Google Mail.

Damit könnt ihr Aktionen hinzufügen, die eure Assistenten ausführen können. Zum Beispiel:

- Schreiben von E-Mail-Entwürfen und Senden an Google Mail oder Outlook

- Erstellen oder Aktualisieren von Deals in HubSpot

- Schreiben und Aktualisieren von Tickets in Jira

- Einen Eintrag in ein Google Sheet oder ein Excel Sheet hinzufügen

- Eine Nachricht in einem Microsoft Teams-Chat senden

- Und viele mehr...

Hier findet ihr weitere Details zur Nutzung. Wenn euch eine Integration oder eine spezifische Aktion fehlt, lasst es uns gerne wissen!

Eigene Tools integrieren

Das Langdock-Team wird in den kommenden Wochen Integrationen zu allen Standardsoftware-Tools erstellen. Wenn wir (noch) keine Integration haben oder ihr ein internes Tool integrieren möchtet, könnt ihr eure eigenen Integrationen erstellen.

Wir haben die vorherigen OpenAPI-Schema-basierten Integrationen mit einem einfacheren Integrations-Builder ersetzt. Dieser ermöglicht es auch, eigenes JavaScript zu schreiben, um alle Arten von Sonderfällen abzudecken. Die Integrationen/Aktionen leben jetzt außerhalb der Assistenten, sodass ihr sie in mehreren Assistenten teilen und wiederverwenden könnt. Ihr könnt diesem Guide folgen, um eure eigenen REST-API-basierten Integrationen einzurichten.

Verbesserungen bestehender Integrationen und Wissensquellen

Wir haben auch die Oberfläche und das Nutzung bestehender Integrationen verbessert. Hier sind die wichtigsten Änderungen:

- Wenn ihr ein Dokument von einer Integration (z.B. SharePoint oder Google Drive) als Assistentenwissen anhängt, aktualisieren wir jetzt den Inhalt des Dokuments alle 24 Stunden. Dies stellt sicher, dass ihr immer mit der neuesten Version des Dokuments in euren Langdock-Assistenten arbeitet. Ihr könnt ein Dokument auch jederzeit manuell aktualisieren.

- Wissensordner können jetzt mit Nutzern, Gruppen und dem Workspace geteilt werden (ähnlich wie Assistenten). Die Wissensordner wurden von den Kontoeinstellungen in das Integrationsmenü verschoben, um sie sichtbarer zu machen.

- Wenn ihr bereits eigene Aktionen in einem Assistenten erstellt habt, sind diese weiterhin für einige Zeit verfügbar. Diese sind als read-only markiert, da sie am 30. April eingestellt werden. Wir empfehlen, eure bestehenden Aktionen auf unsere neuen, verbesserten Aktionen zu migrieren. Wenn eure Aktion noch nicht sofort verfügbar ist, lasst es uns wissen, wenn ihr Hilfe bei der Migration benötigt.

- Vektordatenbanken wurden ebenfalls von individuellen Assistenten in das Integrationsmenü verschoben, um die Wiederverwendung von Verbindungen zu diesen zu erleichtern. Assistenten mit bestehenden Vektordatenbanken wurden entsprechend migriert, um sicherzustellen, dass sie wie zuvor funktionieren.

Zusätzliche Informationen für Workspace-Admins:

- Standardmäßig sind alle Integrationen aktiviert. Ihr könnt hier konfigurieren, welche Integrationen in eurem Workspace aktiviert werden sollen.

- Workspace-weite Integrationen (Google Drive & Confluence über Service Accounts) sind jetzt zugunsten der neuen Integrationen eingestellt. Bitte informiert eure Nutzer, damit sie die Integrationen manuell konfigurieren können. Die Funktionen und Berechtigungen sind komplett über die neuen Integrationen abgedeckt.

- Die Berechtigungen pro Nutzerrolle haben sich geändert, um das neue Integrations-Framework abzubilden: Die Berechtigungen „Vektordatenbanken verbinden“ und „Aktionen verbinden“ wurden entfernt, und die neuen Berechtigungen sind „Wissensordner teilen“ und „Integrationen erstellen“.

Diese neuen Integrationen werden viele weitere Use Cases in Langdock ermöglichen, und dieses Update ist erst der Start. In den kommenden Wochen werden wir viele weitere Funktionen hinzufügen, um mit allen möglichen Arten von Daten in Langdock zu arbeiten. Mehr dazu bald!